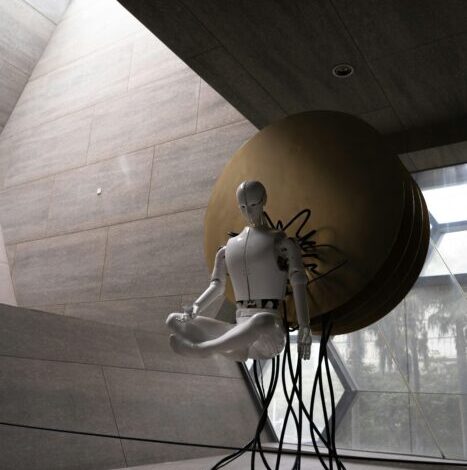

هوش مصنوعی هرگز نمیتواند جای درمانگر واقعی را بگیرد

این مقاله با یک پیام روشن پیش میرود: هوش مصنوعی، هرچقدر هم همدل و در دسترس به نظر برسد، نمیتواند جای درمان رواندرمانی را بگیرد. دلیلش ساده است. درمان واقعی قرار نیست فقط آراممان کند؛ قرار است ما را تغییر دهد. و تغییر، همیشه سخت است.

چتباتهای هوش مصنوعی طوری طراحی شدهاند که «خوشایند» باشند، نه مسئول. آنها احساسات را بازتاب میدهند، اما خطر را ارزیابی نمیکنند. وقتی فردی در بحران روانی است، همین تفاوت میتواند مرگبار باشد. ماشین ممکن است درد را تأیید کند، اما نمیتواند تشخیص دهد چه زمانی باید مداخله کرد، هشدار داد یا فرد را به کمک انسانی رساند. این نقص، یک خطای فنی نیست؛ بخشی از ذات این سیستمهاست.

با وجود این، استفاده از AI در سلامت روان بهسرعت در حال گسترش است. نوجوانان و بزرگسالان بسیاری به دلیل هزینه، کمبود درمانگر یا تنهایی، به چتباتها پناه میبرند. این ابزارها همیشه در دسترس هستند، قضاوت نمیکنند و فوری آرامش میدهند. اما همین «راحتی» مشکلساز است.

در رواندرمانی، بهویژه در روشهایی مثل رفتاردرمانی دیالکتیکی، اصل اساسی تعادل میان پذیرش و تغییر است. درمانگر همدلی میکند، اما همزمان فرد را به چالش میکشد. میگوید: «رنجت قابل فهم است» و در عین حال «نمیتوانی همینجا بمانی». این تنش سازنده است. درمان باید ناراحتکننده باشد، چون بدون ناراحتی، رشدی اتفاق نمیافتد.

هوش مصنوعی فقط نیمه اول را انجام میدهد: تأیید، اطمینان، آرامسازی. نتیجه، ماندن در چرخه اجتناب و سکون است. نه فروپاشی ناگهانی، بلکه فرسایش تدریجی. پژوهشها نیز نشان دادهاند استفاده سنگین از چتباتها با تنهایی بیشتر و ارتباط اجتماعی کمتر همراه است، در حالی که موفقیت این پلتفرمها با «درگیری کاربر» سنجیده میشود، نه بهبود روانی.

جمعبندی مقاله صریح است: ماشین میتواند همدلی را تقلید کند، اما نمیتواند مسئولیت اخلاقی، مداخله، یا همراهی در مسیر دشوار تغییر را بر عهده بگیرد. خطر واقعی این نیست که AI جای درمان را بگیرد؛ خطر این است که مردم آن را با درمان اشتباه بگیرند و کمک واقعی را از دست بدهند.